视频目标检测是计算机视觉领域中的一项基础而又重要的研究方向。现有的视频目标检测方法通常一次性聚合多个帧的特征,以缓解目标表观退化问题(如运动模糊、目标遮挡等)。然而,大部分现有方法在特征聚合的过程中并未考虑监管知识,因此仍然存在特征聚合不充分的问题。

近日,学校数据科学学院齐强老师的论文《DGC-Net: Dynamic Graph Contrastive Network for Video Object Detection》发表在CCF A类、中科院一区Top期刊IEEE Transactions on Image Processing上,影响因子为13.7。IEEE TIP在图像处理和视觉领域具有非常高的学术地位。

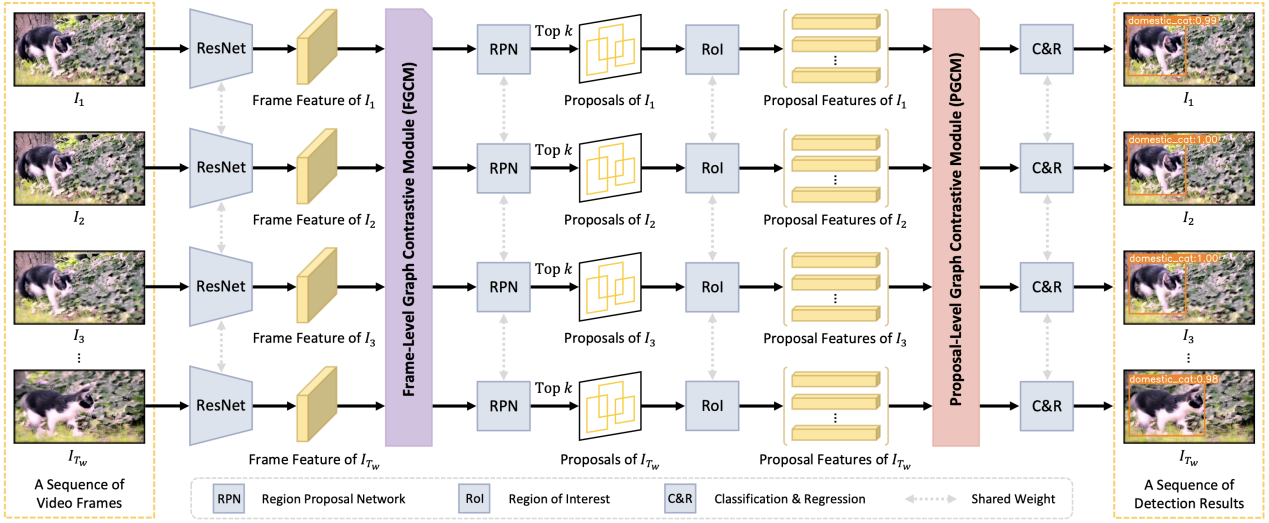

论文从不同角度进行帧间特征聚合,提出了一种基于动态图对比网络(DGC-Net)的视频目标检测方法。该方法使用了两种不同级别的图对比学习来渐进式地指导帧间特征聚合,以聚合更加有益的时空信息,增强视频目标检测的性能。在公开的ImageNet VID数据集上进行了大量实验,实验结果表明所提出DGC-Net在检测精度方面优于大部分现有的视频目标检测方法。

论文信息:

Q. Qi, H. Wang, Y. Yan and X. Li. DGC-Net: Dynamic Graph Contrastive Network for Video Object Detection. IEEE Transactionson Image Processing, 2025, 34: 2269-2284.

https://ieeexplore.ieee.org/abstract/document/10934730